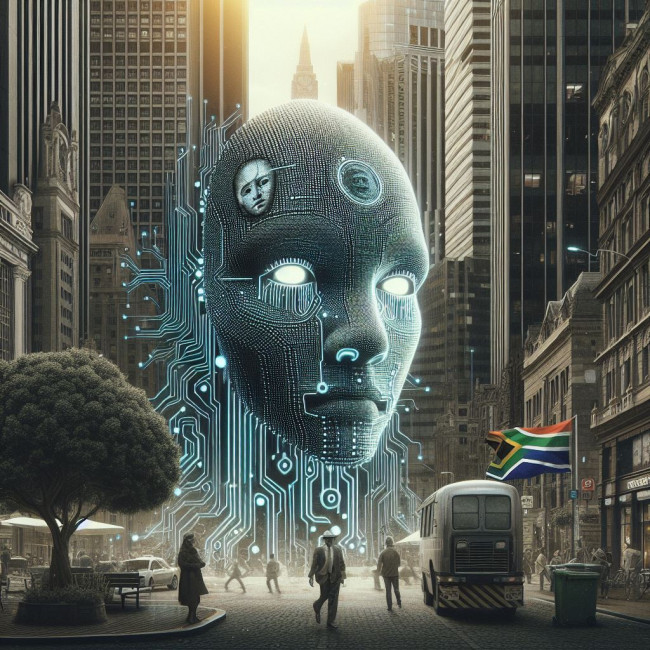

Deepfake KI Bilder, Videos - Der Betrug, auf den 80% der Südafrikaner hereinfallen

Fast acht von zehn Südafrikanern können keinen Unterschied zwischen einem echten Bild und einem von KI generierten Bild (Deepfake) erkennen. Laut der neuesten Kaspersky Business Digitization-Umfrage gaben 42% der befragten Mitarbeiter in Südafrika an, dass sie den Unterschied zwischen einem Deepfake und einem echten Bild erkennen könnten. In Wirklichkeit konnten jedoch nur 21% tatsächlich den Unterschied erkennen. Das berichtet jetzt das südafrikanische Portal businesstech.co.za.

Kaspersky warnt, dass dies Organisationen anfällig für Betrügereien macht, die Deepfakes verwenden, wie zum Beispiel gefälschte Videos und Bilder, um Menschen zu betrügen. Zum Beispiel können Cyberkriminelle ein gefälschtes Video eines CEO verwenden, der eine EFT anfordert, um Unternehmensgelder zu stehlen. 55% der Mitarbeiter gaben an, dass ihr Unternehmen aufgrund von Deepfakes Geld verlieren könnte.

Die Rolle von Deepfakes bei der Manipulation der öffentlichen Meinung

Cyberkriminelle können Deepfakes auch verwenden, um falsche Informationen zu verbreiten und die öffentliche Meinung zu manipulieren. Ein Beispiel dafür ist ein Deepfake von Elon Musk.

“Obwohl viele Mitarbeiter behaupteten, dass sie einen Deepfake erkennen könnten, zeigte unsere Forschung, dass nur die Hälfte von ihnen dies tatsächlich konnte. Es ist durchaus üblich, dass Benutzer ihre digitalen Fähigkeiten überschätzen; für Organisationen bedeutet dies Schwachstellen in ihrer menschlichen Firewall und potenzielle Cyberrisiken - für Infrastruktur, Gelder und Produkte”, sagte Dmitry Anikin, leitender Datenwissenschaftler bei Kaspersky.

Schutz vor Deepfakes

Kaspersky empfiehlt folgende Maßnahmen zum Schutz vor Deepfakes:

Überprüfen Sie die Cybersicherheitspraktiken in Ihrer Organisation - nicht nur in Form von Software, sondern auch in Form von entwickelten IT-Fähigkeiten. Stärken Sie die unternehmensinterne “menschliche Firewall”:

Stellen Sie sicher, dass die Mitarbeiter verstehen, was Deepfakes sind, wie sie funktionieren und welche Herausforderungen sie darstellen können. Führen Sie fortlaufende Sensibilisierungs- und Bildungsmaßnahmen durch, um den Mitarbeitern beizubringen, wie man einen Deepfake erkennt.

Nutzen Sie qualitativ hochwertige Nachrichtenquellen. Informationsanalphabetismus bleibt ein entscheidender Katalysator für die Verbreitung von Deepfakes.

Haben Sie gute Protokolle wie “Vertrauen, aber überprüfen”. Eine skeptische Haltung gegenüber Sprachnachrichten und Videos garantiert nicht, dass Menschen nie getäuscht werden, kann aber dazu beitragen, viele der häufigsten Fallen zu vermeiden.

Achten Sie auf die Schlüsselmerkmale von Deepfake-Videos, um nicht zum Opfer zu werden: ruckartige Bewegungen, Lichtwechsel von einem Frame zum nächsten, Hauttönungswechsel, seltsames Blinzeln oder gar kein Blinzeln, schlecht synchronisierte Lippen mit Sprache, digitale Artefakte auf dem Bild, Video absichtlich in schlechter Qualität kodiert und hat schlechte Beleuchtung.