Digitale Gefahr: Wenn das Teilen in sozialen Medien zur Bedrohung wird

Warum unser digitales Verhalten längst reale Konsequenzen hat – und wie wir uns schützen könne. Das neue Normal: Milliarden Inhalte, millionenfaches Risiko.

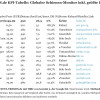

Soziale Medien sind heute allgegenwärtig. Facebook zählt täglich über 2,1 Milliarden aktive Nutzer, Instagram verarbeitet rund 1,3 Milliarden geteilte Bilder pro Tag, und X (ehemals Twitter) wird monatlich von über 600 Millionen Menschen genutzt. Was ursprünglich dem Austausch mit Freunden diente, ist inzwischen zu einem riesigen Datenarchiv geworden – offen einsehbar, leicht durchsuchbar und für Kriminelle eine Fundgrube.

Eine aktuelle Analyse des KI-Tools AIPRM zeigt, wie gefährlich unbedachtes Teilen in sozialen Netzwerken sein kann – vom Identitätsdiebstahl über Deepfakes bis hin zur Rufschädigung. Die Untersuchung enthält zugleich Empfehlungen für mehr digitale Sicherheit im Alltag.

Was ist AIPRM – und wer steckt dahinter?

AIPRM wurde vom österreichischen Unternehmer Christoph C. Cemper gegründet, der seit 2003 im Bereich Software-as-a-Service (SaaS) tätig ist und als Spezialist für SEO-Tools und KI-gestützte Textsysteme gilt. Der Standort Wien spielt für die geschäftlichen Aktivitäten von AIPRM eine zentrale Rolle. Das Unternehmen ist laut eigenen Angaben international tätig und betreut eine breite Nutzerschaft.

AIPRM bietet eine Plattform zur Verwaltung sogenannter Prompts – also Texteingaben für Sprachmodelle wie ChatGPT –, die vor allem von Agenturen, Marketingteams und Content-Erstellern eingesetzt wird. Ziel ist es, Arbeitsprozesse zu beschleunigen, Inhalte effizient zu generieren und KI-Systeme besser zu steuern.

Positive Bewertungen – aber auch kritische Stimmen

AIPRM wird von vielen als leistungsstarkes, intuitives und vielseitiges Tool wahrgenommen. Gelobt wird insbesondere die große Auswahl an vorgefertigten Prompts, die einfache Benutzeroberfläche sowie die schnellen Ergebnisse bei Standardaufgaben wie SEO-Optimierung, Textgenerierung oder Bewertungserstellung.

Doch trotz dieser Stärken gibt es auch kritische Rückmeldungen von Nutzern:

Preisgestaltung: Die Kosten werden von einigen Kunden als vergleichsweise hoch empfunden. Besonders kleinere Unternehmen und Einzelpersonen kritisieren, dass das Verhältnis zwischen Preis und Leistungsumfang nicht immer als ausgewogen wahrgenommen wird.

Leistungsprobleme: Es gibt Berichte über gelegentliche Performance-Einbrüche, etwa wenn das Tool langsamer reagiert oder Funktionen zeitweise nicht verfügbar sind – insbesondere bei hoher Auslastung oder nach Updates.

Begrenzte Anpassungsoptionen: Manche Nutzer wünschen sich mehr Flexibilität bei der Individualisierung von Prompts und Workflows. Derzeit seien Anpassungen nur begrenzt möglich, was komplexere Einsatzszenarien erschwere.

Konkurrenzdruck: Der Markt für KI-basierte Content-Tools ist stark umkämpft. Anbieter wie neuroflash, moinAI oder Creaitor bieten teils günstigere oder stärker spezialisierte Lösungen. Wer gezielt auf Textqualität, kreative Sprache oder Multilingualität angewiesen ist, prüft laut Beobachtern zunehmend auch Alternativen.

Fazit: Trotz einzelner Kritikpunkte wird AIPRM insgesamt als nützliches Werkzeug mit hoher Praxisrelevanz eingeschätzt – insbesondere für Unternehmen, die regelmäßig KI-gestützte Inhalte für SEO, Marketing oder Support erstellen. Die Plattform ist etabliert, wird weiterentwickelt und verfügt über eine treue Nutzerbasis – doch die wachsende Konkurrenz zwingt zur laufenden Optimierung.

Identitätsdiebstahl: Wenn das digitale Ich zur Beute wird

Die britische National Fraud Database verzeichnete im Jahr 2024 mehr als 421.000 gemeldete Betrugsfälle – so viele wie nie zuvor. Besonders auffällig: Der Großteil dieser Delikte betrifft den Identitätsmissbrauch, häufig ausgelöst durch Informationen, die Nutzer selbst in sozialen Medien preisgeben.

„Soziale Netzwerke sind ein offenes Archiv persönlicher Informationen – und damit ein Paradies für Betrüger“, warnt Christoph C. Cemper. „Mit KI lassen sich heute aus öffentlich sichtbaren Daten täuschend echte Dokumente erzeugen – Ausweise, Rechnungen, Verträge.“

Selbst harmlos wirkende Angaben wie der Geburtsort, Arbeitgeber oder der Name eines Haustiers können laut Cemper ausreichen, um Passwörter zu erraten oder Konten zu übernehmen.

Social Engineering: Manipulation mit System

Neben dem Identitätsdiebstahl wächst die Gefahr durch Social Engineering. Dabei geben sich Betrüger in Netzwerken als Vertrauenspersonen aus, um sensible Daten zu erschleichen oder Schadsoftware zu verbreiten. KI-generierte Inhalte erschweren es zunehmend, Wahrheit und Täuschung zu unterscheiden.

„Vertrauen ist im Netz zur größten Schwachstelle geworden“, sagt Cemper. „Gerade in Zeiten von Deepfakes fällt es schwer, echte Kontakte von Betrügern zu unterscheiden.“

Stimmklone und Deepfakes: Die Stimme als Waffe

Bereits wenige Sekunden Audiomaterial reichen aus, um mit KI eine täuschend echte Stimmkopie zu erzeugen. In Kombination mit öffentlich zugänglichen Fotos entstehen realistische Deepfakes, die für Erpressung, Identitätsbetrug oder Rufmord verwendet werden können.

„Selfies und Tonaufnahmen liefern das Material für digitale Angriffe“, so Cemper. Besonders gefährdet seien Personen mit öffentlichem Profil oder hoher Online-Präsenz.

Digitale Rufschädigung: Wenn Likes zur Last werden

In sozialen Medien ist nichts wirklich privat. Ein Like auf einen fragwürdigen Beitrag oder ein Kommentar unter einem irreführenden Video kann auch Jahre später Folgen haben – bei Bewerbungen, in der Öffentlichkeit oder im beruflichen Umfeld.

„Was heute unbedacht geschieht, kann morgen zum Problem werden“, sagt Cemper. „Die digitale Öffentlichkeit vergisst selten – und verzeiht kaum.“

Sharenting: Die Datenfalle für Kinder

Immer mehr Eltern teilen stolz Fotos und Informationen über ihre Kinder. Dabei entstehen digitale Fußabdrücke, die für Kriminelle leicht zugänglich sind – etwa durch Geotags, Namensnennungen oder regelmäßige Standortangaben.

„Kinder haben keine Kontrolle über das, was über sie gepostet wird“, mahnt Cemper. „Die Verantwortung liegt bei den Eltern – und die Risiken reichen von Identitätsdiebstahl bis zu Cybermobbing.“

Was tun? Tipps für mehr digitale Wachsamkeit

Die AIPRM-Analyse empfiehlt:

Datenschutzeinstellungen regelmäßig prüfen und Profile möglichst auf privat stellen.

Persönliche Informationen nicht öffentlich teilen, insbesondere keine Wohnorte, Geburtsdaten oder Aufenthaltsorte.

Sichere Passwörter nutzen und Zwei-Faktor-Authentifizierung aktivieren.

Keine Links von unbekannten Absendern anklicken, auch nicht in Kommentaren oder Direktnachrichten.

Verdächtige Aktivitäten melden – sowohl der Plattform als auch den zuständigen Behörden.

Fazit: Mehr Vorsicht, weniger Offenheit – das Netz vergisst nichts

Soziale Netzwerke bieten viele Möglichkeiten, aber auch viele Risiken. Wer überlegt postet und seine digitale Privatsphäre schützt, reduziert nicht nur die Gefahr für sich selbst, sondern auch für Freunde, Familie und Kollegen.

Was heute geteilt wird, kann morgen zur Bedrohung werden. Die AIPRM-Analyse zeigt eindrücklich, wie wichtig es ist, das eigene Verhalten im Netz zu überdenken – nicht aus Angst, sondern aus Verantwortung.

Weitere Informationen zur Untersuchung und zur Plattform AIPRM finden Sie unter:

🔗 www.aiprm.com/prompts

Quellen zur Einordnung von AIPRM:

[1] https://www.christophcemper.com/de/

[2] https://www.aiprm.com/de/unternehmen/

[3] https://www.absatzwirtschaft.de/die-maschinenfluesterer-249353/

[4] https://www.gruender.de/kuenstliche-intelligenz/prompt-engineer-werden/

[5] https://www.christophcemper.com/de/brands/aiprm/

[6] https://omr.com/de/reviews/product/aiprm-for-chatgpt

[8] https://ki-beraterportal.de/zukunftsjob-ki-prompt-engineer/